关于月之暗面AI和Kimi K2(Hub上的新#1模型)你需要知道的5件事

你可能从未听说过月之暗面AI,但他们的最新发布模型Kimi K2在不到24小时内成为Hugging Face上的热门模型榜首——超越数千个竞争对手,位居榜首。这家中国初创公司默默地构建了一款在编程任务上超越GPT-4的模型,并将其开源到Hub上。

以下是帮助你更好地了解这家初创公司及其模型的关键事实,其中包括由Tiezhen翻译的两篇中文采访中的见解。

月之暗面AI是什么?他们如何在18个月内从零做到33亿美元估值?

月之暗面AI由三位清华大学校友——杨植麟、周昕宇和吴育昕于2023年3月共同创立。在OpenAI的ChatGPT于2022年11月取得突破后,杨植麟回到美国,并坚信是时候“顺应潮流”发展生成式AI了。杨植麟在微信采访中表示:“ChatGPT的发布令人兴奋。我感觉到许多变量将发生变化——资本和人才,AI的两个核心要素。如果这些变量发生变化,就有真正的机会从零开始建立一个以AGI为唯一目的的公司。”(此处有翻译)

他在三个月内筹集了6000万美元,并组建了一个40人的AI团队。

月之暗面AI在2023年10月推出其ChatGPT风格的聊天机器人Kimi后迅速崛起。它因处理高达200万字符的海量文本输入而在中国广受欢迎。

在不到两年的时间里,这家初创公司通过两轮融资筹集了约12.7亿美元,使其估值达到33亿美元。主要投资者包括阿里巴巴、腾讯、美团和红杉中国(原红杉中国)。

趣闻:该公司中文名称“月之暗面”是对Pink Floyd乐队的致敬,反映了CEO杨植麟对经典摇滚的热爱,以及公司探索未知AI领域的使命。这一主题也延伸到办公室的命名中。

月之暗面AI的CEO杨植麟是谁?

31岁的杨植麟是卡内基梅隆大学的博士,曾共同撰写了Transformer-XL和XLNet的基础论文——这些研究为你今天使用的许多AI系统提供了支持。他在攻读博士学位期间还在Meta AI和Google Brain工作过。

杨植麟的愿景专注于通用人工智能:“AGI是未来十年唯一重要的事情。”

AI不是在短短一两年内找到产品与市场的契合点;它关乎在十年到二十年内改变世界——这是两种不同的心态。

—— 杨植麟

这驱动了月之暗面专注于三个关键领域:开发“无损长上下文”能力,致力于通用人工智能的构建,以及创建面向消费者的应用而非企业工具。

我们希望在下一个时代,成为一家将OpenAI的技术理想主义与字节跳动的商业哲学相结合的公司。

—— 杨植麟

他的联合创始人带来了互补的技能,足以与大型公司匹敌:周昕宇在资源受限的硬件上部署神经网络方面拥有深厚知识(曾任职于Hulu和腾讯),而吴育昕则带来了Google Brain基础模型团队和Meta AI Research的经验。

Kimi K2的性能与GPT-4及其他行业领先者相比如何?

Kimi K2是一个万亿参数模型,采用混合专家(MoE)架构,每次推理仅激活320亿参数。该模型包含384个具有动态路由的专业专家,61层,64个注意力头,以及128,000个token的上下文窗口。

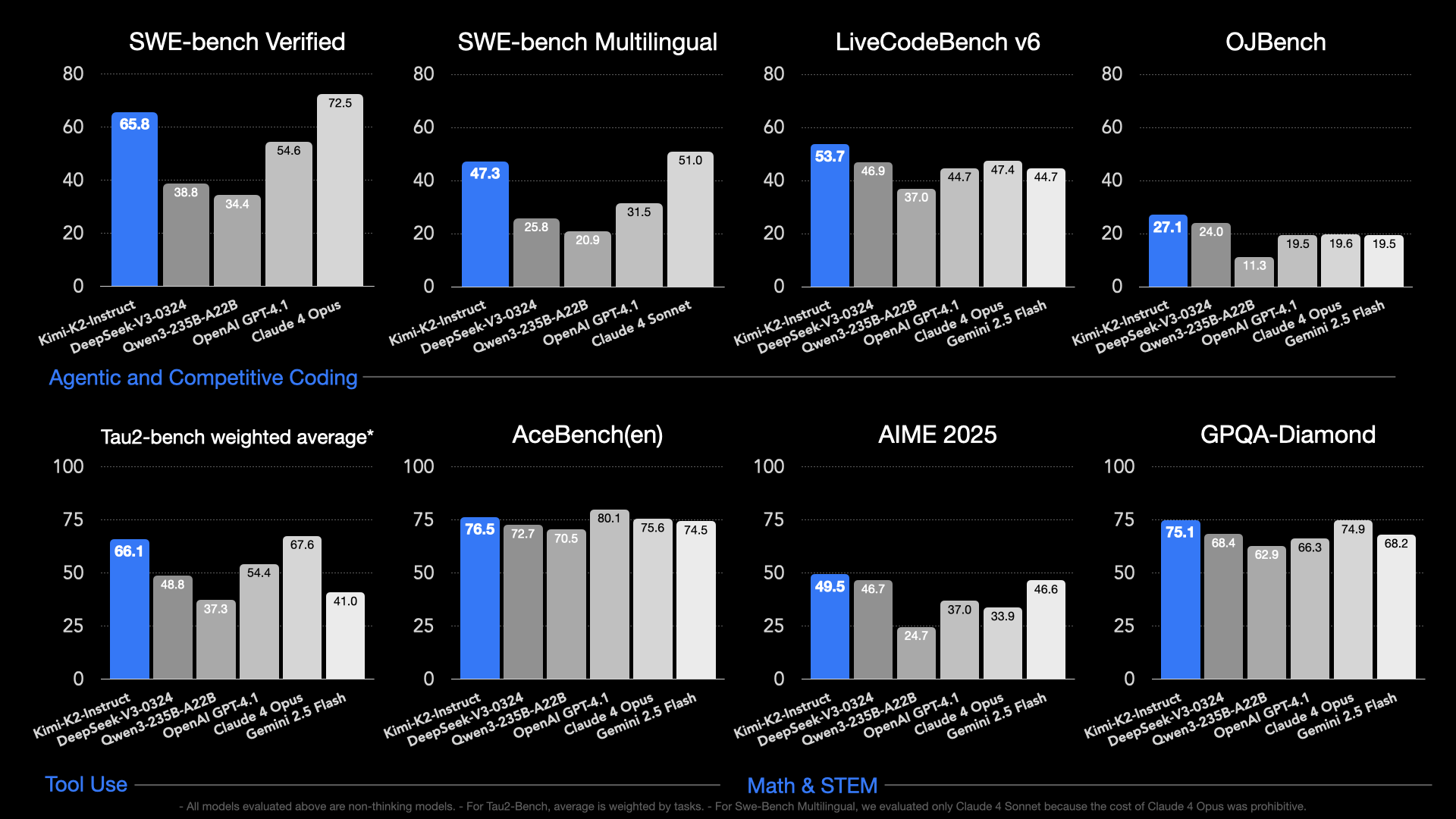

该模型在不同基准测试中优于GPT-4.1、Claude Opus和DeepSeek V3。例如:

- LiveCodeBench v6 (编程): Kimi K2的准确率达到53.7%,而GPT-4.1为44.7%

- SWE-bench Verified (软件工程): 单次尝试准确率为65.8%,重试后为71.6%

- MATH-500 (数学问题): 准确率为97.4%

月之暗面还在演示中展示了代理能力,包括:

- 16步的自主薪资分析,并附带交互式图表

- 17步的演唱会计划,使用搜索、日历、电子邮件和机票预订应用中的多个工具调用

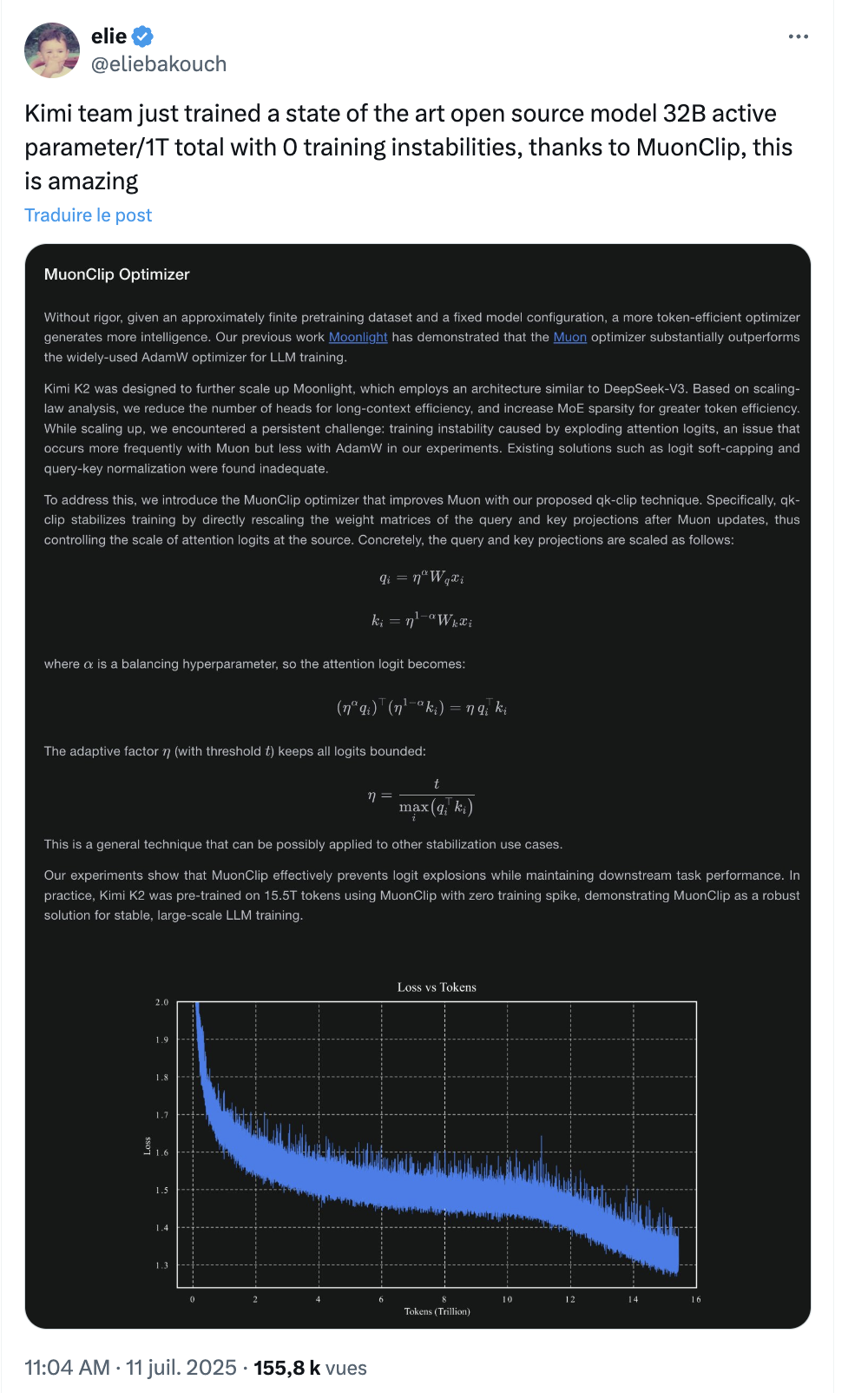

Muon优化器是什么?它为何改变了AI训练的一切?

Kimi K2背后的真正创新是Muon优化器的实现——这是由包括Keller Jordan在内的AI研究人员开发的一项数学突破。月之暗面AI和加州大学洛杉矶分校的研究人员随后在2025年初发表了一篇研究论文,表明Muon可用于LLM训练。传统优化器常常陷入主导方向,就像指南针一直指向一个方向。Muon通过使用矩阵正交化解决了这个问题——这有助于模型探索更广阔的解决方案空间,避免局部陷阱。

关键成果:

- 2倍训练效率

- 内存使用减少50%

- 万亿参数模型在15.5万亿tokens上的零训练失败

增强型变体MuonClip,增加了防止大规模训练不稳定的机制——这使得万亿参数模型的实际训练首次成为可能。

顺便说一下,Muon代表:MomentUm Orthogonalized by Newton-Schulz(牛顿-舒尔茨正交动量)。

月之暗面的研究理念有何不同?

Kimi K2反映了一种关于扩展和长期设计的理念。正如杨植麟所说:“最重要的是从最终结果出发思考。”他们的路线图是由一种信念塑造的,即架构应该演进以适应的不仅仅是人类需求,而是一种新的计算范式。

“无损长上下文至关重要,”杨植麟认为。“如果你拥有十亿的上下文长度,今天所有的问题都将不复存在。”

当token空间足够大时,它就变成了一种新的通用计算机——一个通用的世界模型。

—— 杨植麟

甚至在月之暗面的世界观中,微调也可能是暂时的:“未来,模型将不需要微调;相反,通过强大的上下文一致性和指令遵循能力,它将解决问题。”

月之暗面的开源策略如何颠覆AI经济学,这对你意味着什么?

月之暗面正在开源Kimi K2,并提供API访问,输入tokens仅需每百万$0.15,输出tokens则为每百万$2.50——正如VentureBeat所指出,这一大胆举动削弱了OpenAI和Anthropic的竞争力。

该模型可以:

值得注意的是,月之暗面从闭源转向开源。月之暗面的一名团队成员发布了一篇帖子解释了这一决定,强调了加速部署和提升竞争门槛等原因。

有趣的是,月之暗面的举动是在百度决定开源其文心一言模型之后。分析师 Lian Jye Su 在CNBC上指出:“百度一直非常支持其专有商业模式,并曾明确反对开源,但像DeepSeek这样的颠覆者已经证明,开源模型可以像专有模型一样具有竞争力和可靠性。”

月之暗面的长期愿景也使其在开源与闭源模型上持独特立场。他们公开表示,其重点在于释放规模和加速用例——而非追求排行榜主导地位。用杨植麟的话说:“用户才是唯一的真正排行榜。”

立即体验Kimi K2

在Hugging Face上通过推理提供商试用

探索AI代理工作流: → 考虑AI可以自主完成任务而非仅仅辅助的用例

使用Kimi K2进行“随心编码”: → 与AnyCoder一起使用

深入了解技术细节: → 月之暗面技术博客 → arXiv上的Muon研究论文

深入了解

阅读Tiezhen翻译的杨植麟的两篇采访:→ 一家全新的AGI公司如何超越OpenAI? → Kimi:迈向无尽未知的雪山

感谢Brigitte对本文的评论。