GPTree:通过LLM驱动的决策树实现可解释的决策制定

概述

- 这篇论文提出了一种名为 GPTree 的新方法,它结合了大型语言模型(LLM)和决策树,以实现可解释的决策制定。

- GPTree 使用 LLM 为决策树模型所做的决策生成自然语言解释。

- 作者在一个与创始人成功相关的数据库上评估了 GPTree,展示了它为其预测提供可解释和忠实解释的能力。

通俗易懂的解释

这篇论文介绍了一种名为 GPTree 的新方法,旨在使决策制定更易于理解和透明。决策树是一种机器学习模型,可用于进行预测或决策,但有时人类难以解释。

GPTree 将决策树与大型语言模型(LLM)相结合,LLM 是能够理解和生成类似人类文本的强大人工智能系统。GPTree 的核心思想是使用 LLM 为决策树模型所做的决策生成自然语言解释。这使得模型不仅能够做出预测,还能为这些预测提供清晰易懂的理由。

作者在一个与创业创始人成功相关的数据库上测试了 GPTree,发现它能够为其预测提供可解释和忠实的解释。这表明 GPTree 可以在各种需要人类理解自动化决策背后的推理的领域中,成为可解释人工智能的有用工具。

主要发现

- GPTree 结合了决策树和大型语言模型,以实现可解释的决策制定。

- 作者在一个与创始人成功相关的数据库上评估了 GPTree,发现它能够为其预测提供可解释和忠实的解释。

- 这表明 GPTree 可以在各种需要人类理解自动化决策背后推理的领域中,成为可解释人工智能的有用工具。

技术解释

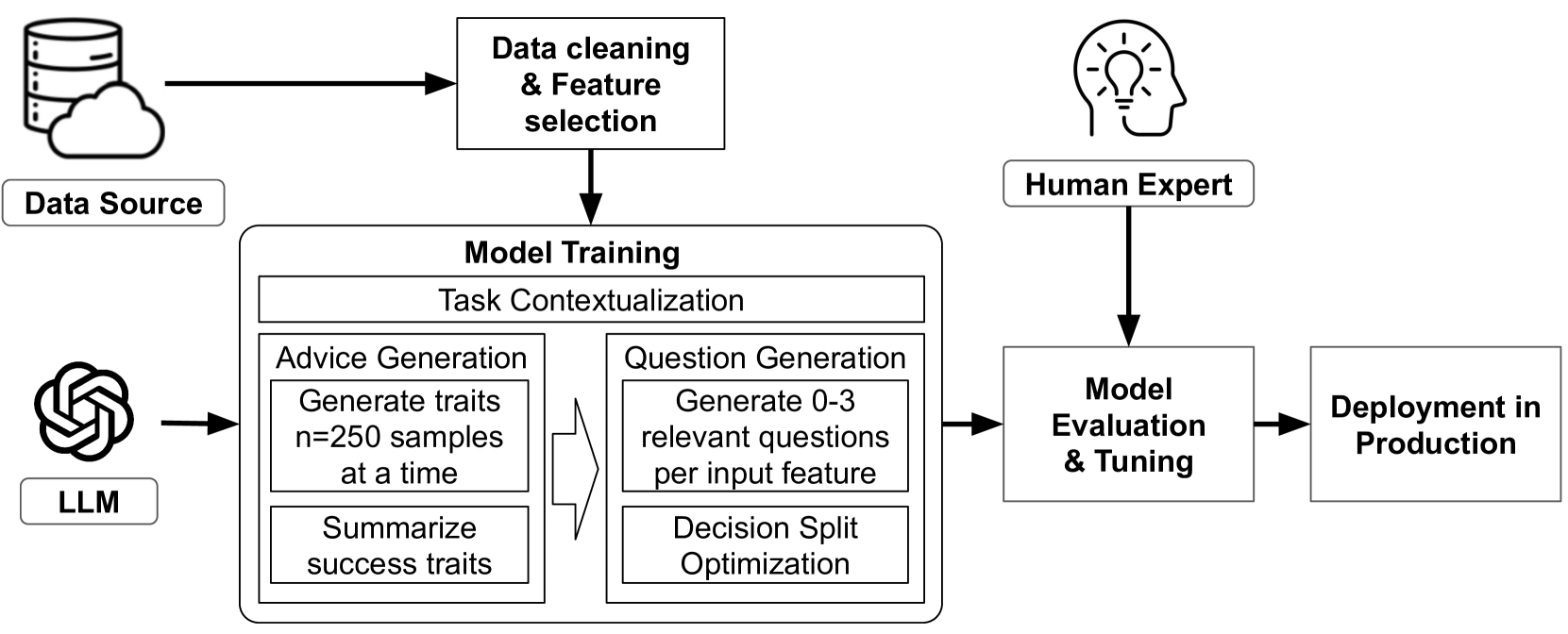

GPTree 的核心思想是使用大型语言模型(LLM)为决策树模型所做的决策生成自然语言解释。作者首先在一个给定的数据库上训练一个决策树模型,然后使用 LLM 为树中的每个决策节点生成解释。

LLM 在大量文本数据语料库上进行训练,这使其能够理解和生成类似人类的自然语言。为了为决策树生成解释,作者向 LLM 提供有关当前决策节点的信息,包括用于做出决策的特征、阈值以及由此产生的预测类别。然后,LLM 生成一个自然语言解释,阐明决策背后的推理。

作者在一个与创业创始人成功相关的数据库上评估了 GPTree,发现它能够为其预测提供可解释和忠实的解释。这表明 GPTree 可以在各种需要人类理解自动化决策背后推理的领域中,成为可解释人工智能的有用工具。

批判性分析

作者承认 GPTree 存在一些局限性。例如,LLM 生成解释的质量将取决于训练数据和 LLM 本身的质量。如果 LLM 在其知识中存在偏差或不准确之处,这些可能会反映在它生成的解释中。

此外,作者指出 GPTree 可能不适用于所有类型的决策问题,特别是那些高度复杂或细致的决策制定过程。在这种情况下,决策树模型可能无法捕捉问题的全部复杂性,并且 LLM 生成的解释可能不够详细或准确。

进一步的研究可以探索提高 GPTree 鲁棒性和多功能性的方法,例如通过结合其他可解释机器学习技术,或者研究使用不同类型的 LLM 或决策树模型。

结论

这篇论文中提出的 GPTree 方法代表了可解释人工智能领域的一个有趣进展。通过结合决策树和大型语言模型,GPTree 能够为自动化决策生成自然语言解释,从而有可能使这些系统对人类用户更透明和值得信赖。尽管该方法存在一些局限性,但作者在一个与创始人成功相关的数据库上的评估表明,GPTree 可以在各种现实世界应用中成为实现可解释决策制定的宝贵工具。