逆向思维让LLM成为更强的推理器

概述

• 引入“逆向思维”以提高LLM推理能力 • 在多个推理基准数据集上进行测试 • 在各种任务中实现了显著的性能提升 • 通过让LLM从答案开始反向解决问题来工作 • 无需额外训练或模型修改

通俗解释

逆向思维就像从终点开始解决迷宫一样。LLM不是从问题开始向前推进,而是从可能的答案开始反向验证它们是否合理。

可以把它想象成规划一次公路旅行。你不是从起点开始规划,而是从目的地开始,然后反向追溯回家。这种方法有助于发现错误并更有效地验证推理路径。

该方法提高了LLM在数学问题、逻辑谜题和常识推理等任务上的表现。这类似于学生通过反向检查数学问题来验证答案。

主要发现

逆向推理方法在多个基准测试中提高了性能。

• GSM8K数学问题提高8.3% • CommonsenseQA结果提高6.2% • LogiQA逻辑推理任务提高5.4%

这些提升在不同模型大小和类型中保持一致,表明这是对推理能力的基本改进。

技术解释

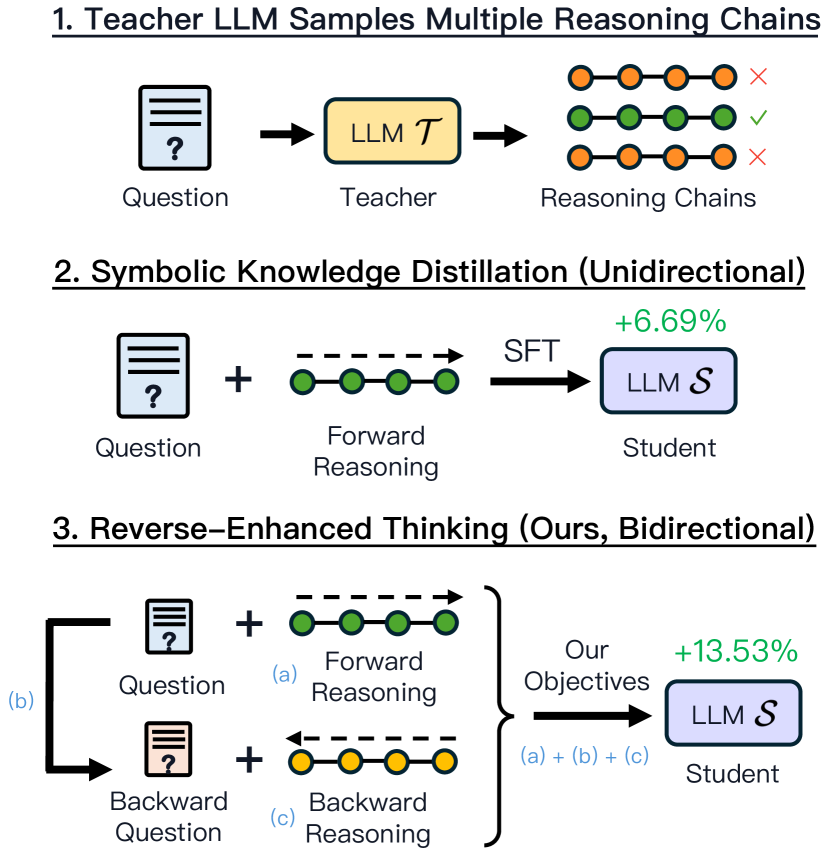

该实现采用两阶段过程。首先,模型通过标准正向推理生成潜在答案。然后,它应用逆向验证来检查每个答案的有效性。

反向过程检查答案与给定信息之间的逻辑连接。这有助于识别仅向前推进可能会遗漏的推理链中的空白或不一致之处。

该方法不需要模型微调或架构更改。它纯粹通过提示工程工作,可以应用于任何现有LLM。

批判性分析

尽管有效,但这种方法也有一些局限性。

• 由于两阶段处理,推理时间加倍 • 可能对需要创造性飞跃的问题没有帮助 • 可能会强化模型推理中的现有偏差

未来的工作可以探索动态结合正向和逆向思维,而不是总是使用这两个阶段。

结论

逆向思维代表了LLM推理能力的重大进步。该方法的简洁性和有效性使其在不同模型和任务中广泛适用。

该方法表明,仅仅通过改变我们使用LLM的方式,就可以实现显著的改进。这表明可能还有其他尚未发现的基本推理技术,可以进一步增强AI能力。