Llama-2-7b 在 AWS Inferentia2 上的性能(延迟和吞吐量)

Llama-2-7b 在 Inferentia2 上的速度如何?让我们来搞清楚!

在这个基准测试中,我们将使用以下配置

| 模型类型 | batch_size | sequence_length |

|---|---|---|

| Llama2 7B BS1 | 1 | 4096 |

| Llama2 7B BS4 | 4 | 4096 |

| Llama2 7B BS8 | 8 | 4096 |

| Llama2 7B BS16 | 16 | 4096 |

| Llama2 7B BS32 | 24 | 4096 |

注意:所有模型都编译为使用 6 个设备,对应于 inf2.48xlarge 实例上的 12 个内核。

注意:有关可用实例的详细信息,请参阅Inferentia2 产品页面。

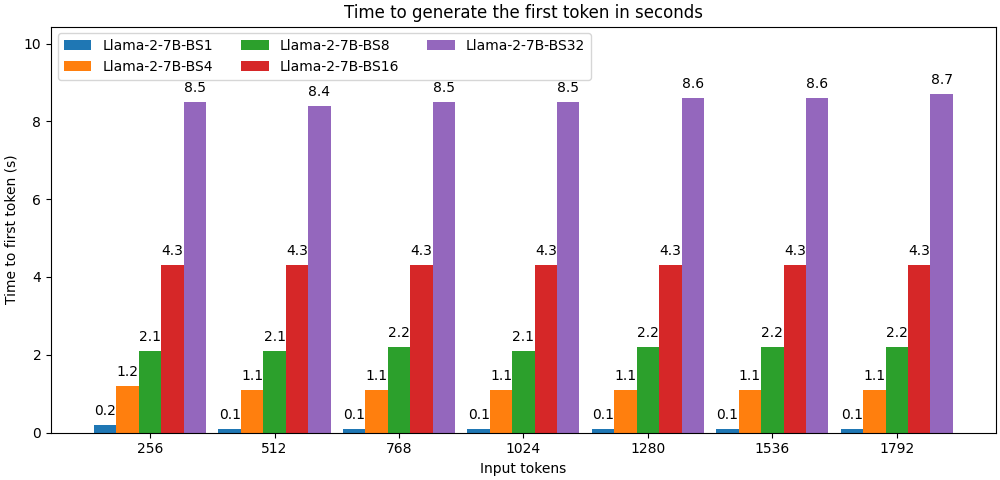

第一个令牌的时间

第一个令牌的时间是指处理输入令牌并生成第一个输出令牌所需的时间。这是一个非常重要的指标,因为它对应于用户在流式传输生成令牌时直接感知的延迟。

我们测试了第一个令牌的时间,用于增加的上下文大小,从典型的问答使用到重量级的检索增强生成 (RAG) 用例。

第一个令牌的时间以秒表示。

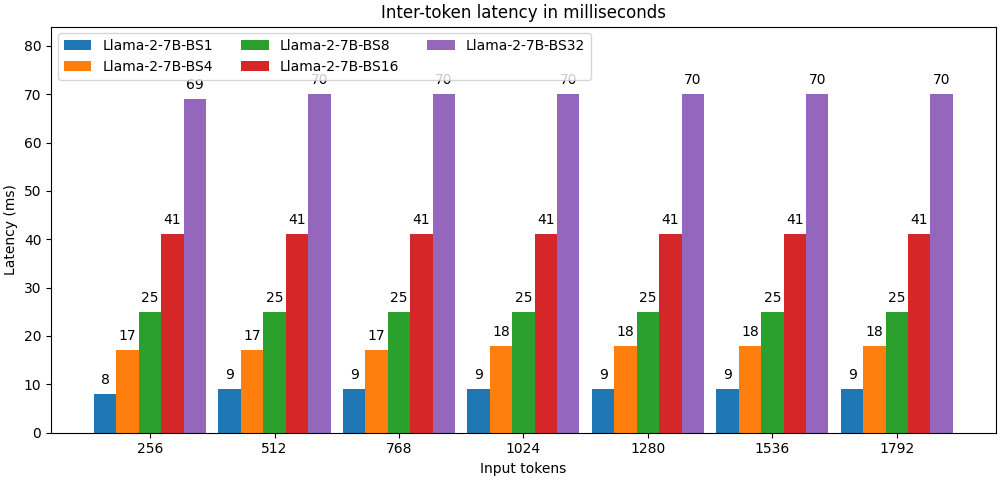

令牌间延迟

令牌间延迟对应于两个生成令牌之间经过的平均时间。

它以毫秒表示。

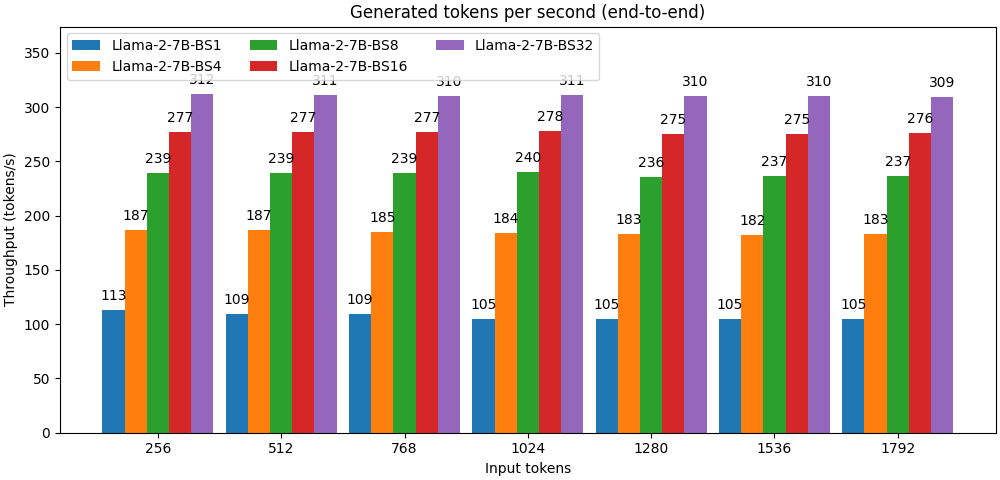

吞吐量

与其他一些基准测试不同,我们只使用生成的 token 来评估吞吐量,方法是将 token 的数量除以端到端延迟。

吞吐量以 **token/秒** 为单位表示。